XLA(Accelerated Linear Algebra)は、OpenXLAによって開発された機械学習向けのオープンソースコンパイラである。XLAは、より低レベルでの計算グラフの最適化により機械学習モデルの性能を向上させるように設計されており、大規模な計算や高性能な機械学習モデルに特に有用である。

XLAの主要な特徴は以下の通りである:

- 計算グラフのコンパイル:計算グラフを効率的な機械コードにコンパイルする。

- 最適化技術:演算の融合、メモリ最適化、その他の技術を適用する。

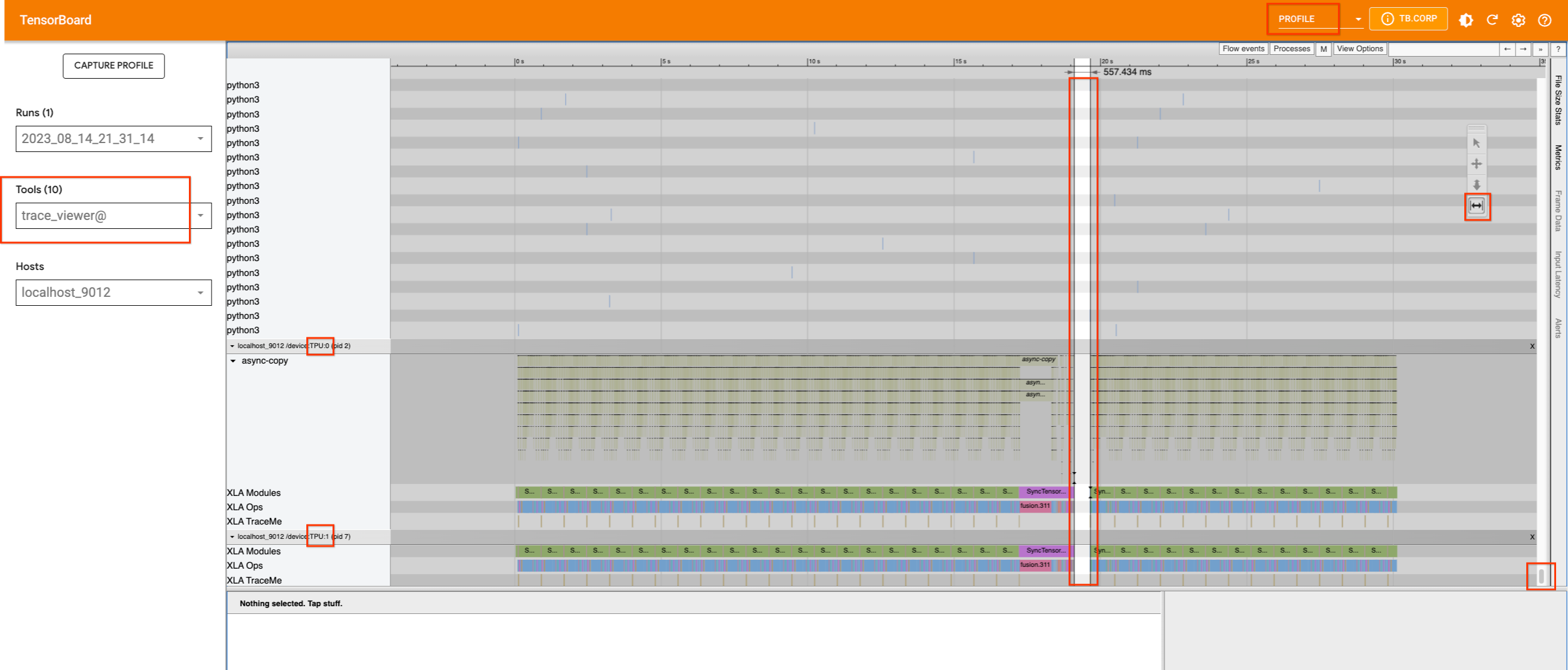

- ハードウェアサポート:CPU、GPU、AIアクセラレータなど、様々なハードウェアに対してモデルを最適化する。

- モデル実行時間の改善:トレーニングと推論の両方において、機械学習モデルの実行時間の短縮を目指す。

- シームレスな統合:既存の機械学習コードに最小限の変更で使用可能である。

XLAは機械学習モデルの最適化における重要な進歩を表しており、開発者に計算効率と性能を向上させるためのツールを提供している。

XLAはTensorFlow、PyTorch、JAXなどから利用可能である。

XLAは、元々は、Googleが開発していたもので、2017年3月6日にTensorFlowの一部として発表された。2022年よりOpenXLAが開発することとなった。OpenXLAにはAlibaba, Amazon Web Services, AMD, Anyscale, Apple, Arm, Cerebras, Google, Graphcore, Hugging Face, Intel, Meta, NVIDIAが参加している。

対応デバイス

- x86-64

- ARM64

- NVIDIA GPU

- AMD GPU

- Intel GPU

- Apple GPU

- Google TPU

- AWS Trainium, Inferentia

- Cerebras

- Graphcore IPU

参照

外部リンク

- 公式ウェブサイト